Javier Tolcachier estuvo con nosotros en el programa de Pressenza, por Radio Pichincha Universal. Esta vez, en el camino hacia el encuentro Diálogos para una Internet Ciudadana, Javier nos adentró en el mundo de los robots asesinos, tema que también será parte del debate durante los días 27, 28 y 29 de septiembre en Quito-Ecuador.

Nos ha llamado mucho la atención, la investigación que estas llevando a cabo en el campo de la inteligencia artificial. ¿Podrías explicar los antecedentes, de qué se trata y cuales son algunos de los avances interesantes en este campo?

La inteligencia artificial era ciencia ficción en los años 40’s y 50’s, hoy es una realidad en marcha, aunque poco difundida en muchos lugares o ámbitos que no tienen relación directa con esta tecnología. La IA se remite a los años 50´ donde un grupo de científicos, encabezados por el matemático norteamericano John McCarthy, comenzaron a investigar e instalaron un laboratorio en el MIT en Massachussets con el objeto de crear maquinas inteligentes, máquinas que utilicen lenguaje, que aprendan por sí mismas, que puedan abstraer, que puedan tomar algún tipo de decisiones y según ellos, resolver problemas que hasta ahora estaban solamente reservados para los humanos.

Todo esto se ha desarrollado mucho, sobre todo en base a las mayores capacidades de las computadoras y al enorme caudal, el enorme crecimiento del caudal de datos disponibles. Estas dos cosas han hecho que esto se desarrolle mucho y hoy la inteligencia artificial ha logrado ya múltiples avances por ejemplo en el campo del reconocimiento de imágenes, el reconocimiento facial, el lenguaje, el diagnóstico preventivo de enfermedades, la comunicación, la domótica, el transporte no tripulado, la robótica industrial y doméstica y un gran número de aplicaciones y sistemas informáticos. Para dar una idea sencilla para que la gente vea qué cerca que está todo esto de la inteligencia artificial de lo cotidiano, muchas aplicaciones, muchos programas y dispositivos que utilizamos diariamente, por ejemplo, cuando buscamos una imagen en Google o cuando utilizamos un geolocalizador, un GPS, todos esos son desprendimientos aplicados de la tecnología conocida como inteligencia artificial.

Muy bien, pero como muchas veces en el pasado, una tecnología que debe usarse para fines humanos se desarrolla a través del militarismo. Hoy en día, ¿cómo se usa esta tecnología en el campo de batalla? ¿Uno puede imaginar que su uso puede reducir los muertos civiles?

Bueno, respecto a la primera pregunta hay que decir que hay distintos tipos de autonomía, o sea armas que funcionan automáticamente pero con distinto tipo de asistencia humana, pero por supuesto el objetivo de los planificadores militares, de los cerebros de la guerra es intentar lograr crecientemente una autonomía total, armamentos que puedan actuar sin necesidad de operadores humanos. Esto en realidad todavía no se ha conseguido, salvo en prototipos, por suerte, pero las armas semiautónomas sí están en uso ya desde los años 80. Por ejemplo, en los barcos de la marina estadounidense y también de otros 25 países fueron instalados sistemas conocidos como Phalanx que tienen un sistema de reconocimiento del acercamiento de objetos adversarios y una respuesta automática con ametralladoras que disparan en caso de ser reconocido el acercamiento como peligroso.

Este mismo sistema pero adaptado a unidades terrestres se utilizó en el 2005 en la Guerra del Golfo. Del mismo modo hoy son utilizados robots de patrullaje que también tienen capacidad de respuesta armada en la zona supuestamente desmilitarizada entre Corea del Sur y Corea del Norte, un armamento desarrollado por la corporación Samsung de Corea del Sur – es importante decirlo porque la gente cuando escucha Corea y armamento, dada la deformación que hay a través de la prensa inmediatamente cree que todo lo armamentístico lo desarrolla Corea del Norte, en este caso no es así -. El sistema que mencionábamos antes, el Phalanx es un desarrollo de la firma norteamericana Raytheon, de la que es accionista Donald Trump.

En cuanto a las armas completamente autónomas, hay prototipos por ejemplo de aviones tripulados como Taranis desarrollado entre Gran Bretaña y España por EADS, que es totalmente autónomo, es no tripulado, tiene posibilidad de recarga en el aire y está previsto que cargue bombas o misiles.

En cuanto a la segunda pregunta, si ésto puede reducir las víctimas civiles, claramente no, ese argumento es propagandístico. Para dar un ejemplo, los drones, que son armamentos semi autónomos, armamentos utilizados con relativo monitoreo y gestión humana a distancia, han matado miles de personas civiles en Afganistán, en Irak, en Somalia, en Yemen, en Pakistán, por sólo mencionar algunos lugares. Según un periódico pakistaní (el Dawn News), por cada activista o terrorista talibán o de Al Qaeda, murieron 140 civiles por los bombardeos de drones así que esto queda absolutamente descartado.

Lo último respecto a esto es que hay que pensar que este tipo de armas semi autónomas o autónomas permitiría operar a un ejército en guerras simultáneas – lo que ahora no es tan fácil porque hay problemas de logística, de desplazamiento – entonces el número de víctimas totales se incrementaría.

¿A pesar de que no aparece este tema en los medios de comunicación, cuáles son los esfuerzos para controlar el uso de estos sistemas autónomos de armas letales?

Bueno, efectivamente Tony, en base a la presión y a la alerta lanzadas por diversos grupos de organizaciones activistas, se han puesto en marcha también académicos, se ha puesto en marcha en Naciones Unidas con una conferencia oficial que intenta discutir el problema de prohibición o restricción de ciertas armas convencionales que incluyen tanto las minas como este tipo de armas semi autónomas o autónomas. En Diciembre de 2016, 123 países se pusieron de acuerdo en convocar para este 2017 a un Comité de Expertos Gubernamentales para que éstos hagan una recomendación al pleno de la asamblea sobre la necesidad de regular y/o prohibir este armamento. En este año se debería haber hecho una sesión en Agosto que se canceló por problemas de presupuesto, pero se va hacer un nuevo intento, una nueva sesión en Noviembre de 2017 para discutir este tema en Naciones Unidas, 19 naciones ya se pronunciaron por la prohibición de estos killer robots.

Hablaste de presión por parte de la sociedad civil, ¿qué respuestas hay, como se puede encontrar más información y saber más?

Es muy interesante la respuesta que se viene dando desde medios académicos e incluso de los fundadores de compañías de inteligencia artificial como Elon Musk, un emprendedor conocido mundialmente.

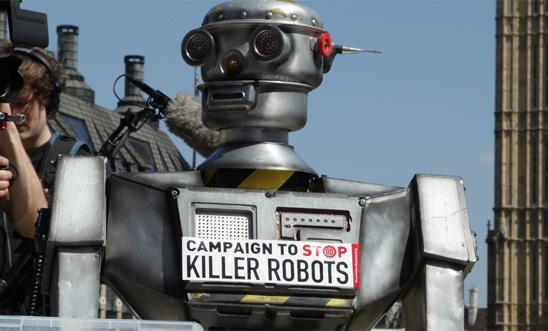

Recientemente 116 de estos fundadores de empresas de IA emitieron una carta, previo a la Conferencia mundial de robótica que se desarrolló en agosto en Melbourne, previniendo sobre la necesidad de prohibir el armamento autónomo. Existe además una alianza de organizaciones conocida como “Stop Killer Robots” – detengamos a los robots asesinos – que está actuando fuertemente en cada uno de estos eventos internacionales tratando de crear conciencia sobre el peligro que resultaría de la utilización y el desarrollo de armas autónomas.

Las reivindicaciones de estas organizaciones son muy claras, indican que se debe adoptar un tratado internacional vinculante para prohibir el desarrollo y uso de armas autónomas, que los estados adopten leyes y políticas nacionales con el mismo fin, además comenzar a revisar tecnologías y componentes que pudieran conducir al desarrollo de esta autonomía en las armas, así que hay mucha actividad, está por supuesto el sitio web de esta alianza www.stopkillerrobots.org, es muy fácil de encontrar.

Por nuestro lado simplemente agregar que creemos además que algo tiene que cambiar en nosotros mismos, no solamente los gobiernos, no solamente en el tema de que las armas dejen de ser negocio, sino que tenemos que cambiar algo en nuestra dirección mental porque lo que es artificial es la violencia y nosotros con la inteligencia humana podemos superarla.